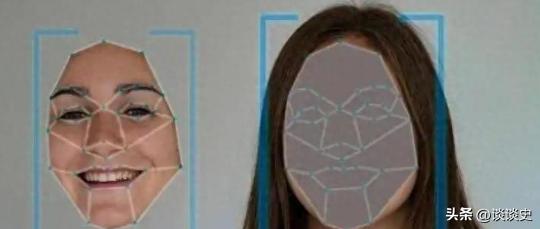

10分钟被骗430万!AI诈骗在全国爆发,这三种“套路”要多加小心。 在我们生活的每个角落,都隐藏着一些心怀不轨的人,他们总想着不劳而获,通过欺骗他人的方式来谋取钱财,这些人就是令人深恶痛绝的骗子,过去,骗子的手段相对简单,无非是街头卖假药、谎称丢钱借钱不还之类的,虽然可恶,但人们多少还能有所防范。 可如今,科技发展得越来越快,骗子的手段也跟着“与时俱进”,变得越来越多、越来越隐蔽,让人防不胜防,特别是AI技术的兴起,更是给骗子提供了新的“作案工具”,AI诈骗在全国范围呈现出爆发的态势,让不少人遭受了巨大的损失。 骗子们常用的手段有智能换脸诈骗、名人仿冒诈骗以及AI语音诈骗,换脸诈骗很好理解,骗子会用AI技术换脸,然后和受害人视频,比如,骗子在网上获取亲人的照片,通过技术将自己的脸成为受害者亲人的脸,然后和受害者视频,再配合上声音的合成技术,起到以假乱真的地步,一旦取得信任,他们就会以各种紧急资金周转的理由,诱导受害者转账。 就像福建的科技公司老板郭先生,在一个普通的工作日,就接到了“好友”的微信视频通话,视频里,“好友”的形象和声音与真实好友毫无差别,对方称在外地竞标急需430万保证金,郭先生出于对好友的信任,再加上视频的“佐证”,短短10分钟内就完成了转账,可当他事后联系真正的好友时,才惊觉自己上当受骗,那430万就这样打了水漂。 还有一些骗子借助AI技术制作以假乱真的名人视频,冒充知名专家、艺人等,他们打着投资理财的幌子,声称有内部消息能获得高额回报,或者伪装成爱心人士,以慈善募捐为借口,骗取人们的钱财,利用大众对名人的信任和对公益的热心,达到自己的犯罪目的。 语音诈骗就是骗子通过AI技术模拟受害者亲友的声音,编造出各种紧急情况,比如家人突发重病急需手术费、孩子意外受伤要马上治疗等,在这种情况下,受害者往往会因为紧张和担心,来不及仔细思考,就匆忙转账。 面对这些新型的AI诈骗手段,我们必须提高警惕,做好预防,对任何涉及转账的请求,不管对方是谁,都要保持高度的警惕,收到视频或语音通话要求转账时,一定要通过其他渠道与对方核实,比如打电话进行确认,再确认时可以说一些只有你们两个人知道的事情,也可以事先和亲戚朋友们交代,彼此之间留个暗号。 现在的骗子还会通过电话提取你的声音,面对那些陌生电话,在接听电话时,可以先不要发出声音,先听对象会说什么,如果真的是毫不相干的人或事,那么可以直接挂断电话,切记,一旦遇到可疑情况,要及时报警,寻求警方的帮助。 在这个AI技术发达的时代,再真实的视频和声音都有可能是伪造的,千万不要被表象所迷惑,一定要守住自己的钱袋子。 在这里也要劝诫那些心怀不轨的人,不要妄图通过违法犯罪的手段来获取利益,天网恢恢,疏而不漏,任何违法的行为最终都逃不过法律的制裁,靠自己的双手,通过正当的途径去努力奋斗,才是获得财富和幸福生活的正确方式。 对此,您怎么看?欢迎在下方评论区留言,麻烦您点击一下“关注”和“点赞”,方便您下次看到更加精彩的内容,祝您生活愉快,感谢支持。