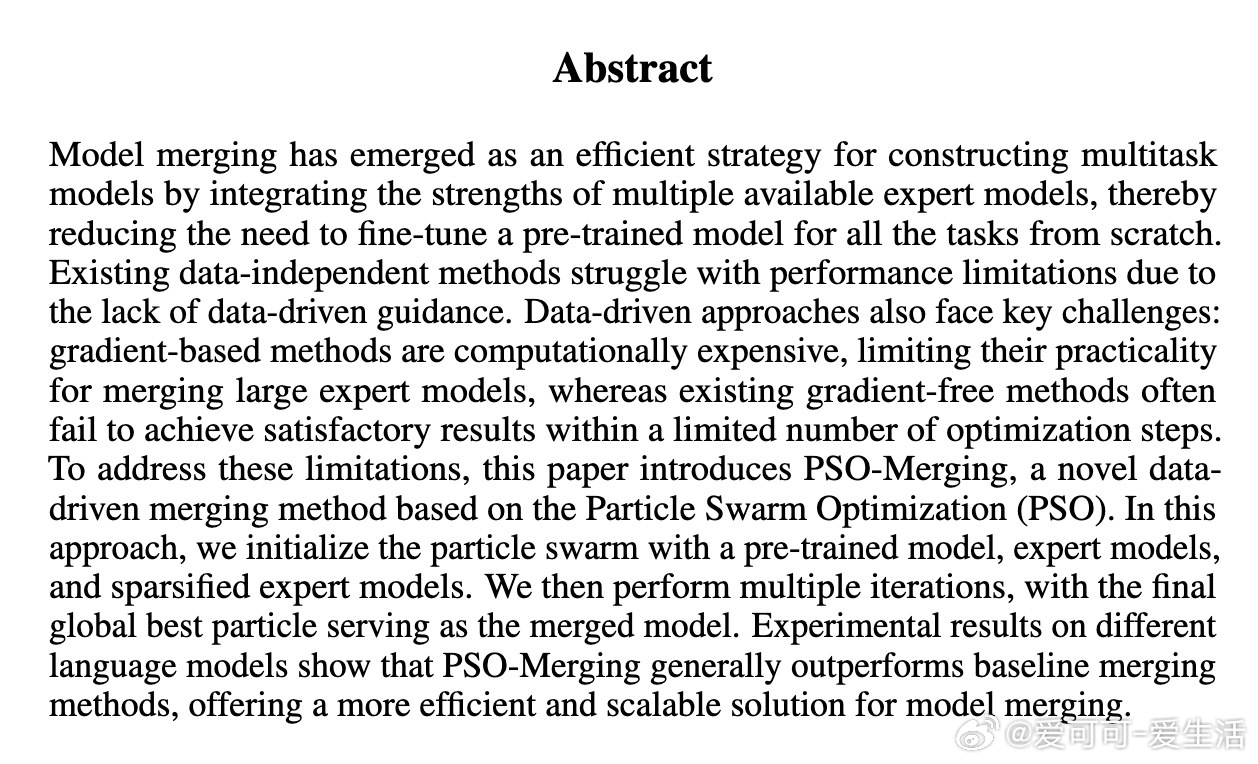

[LG]《PSO-Merging: Merging Models Based on Particle Swarm Optimization》K Zhang, S Zhang, Y Feng [Chinese Academy of Science] (2025)

PSO-Merging:基于粒子群优化的模型合并新范式,助力多任务大模型构建与高效融合

• 创新采用粒子群优化(PSO)算法进行专家模型参数空间的融合,避免昂贵梯度计算,实现高效数据驱动的合并。

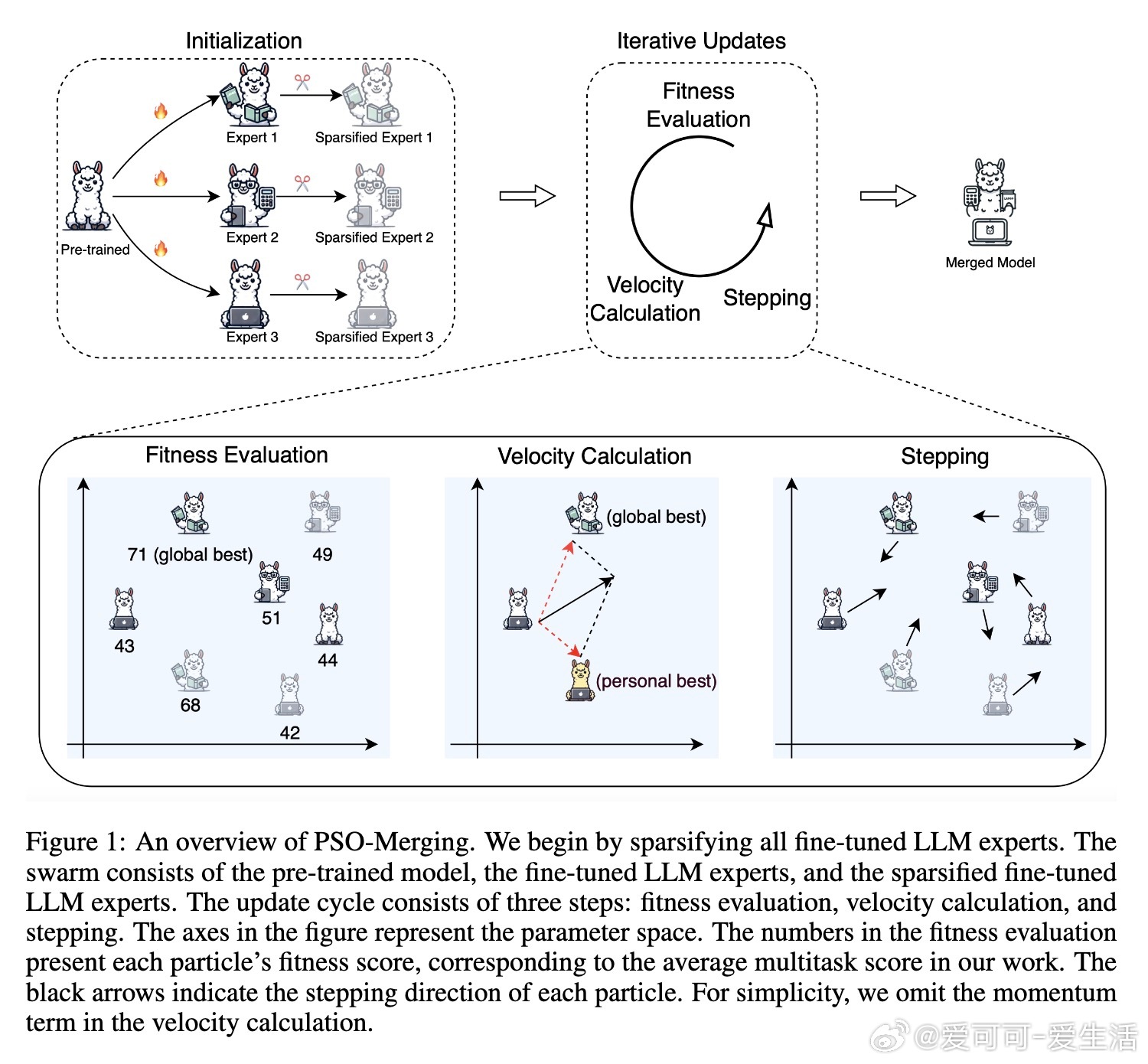

• 初始粒子群由预训练模型、专家模型及其稀疏化版本构成,扩充搜索空间,缓解参数冲突,提升收敛质量。

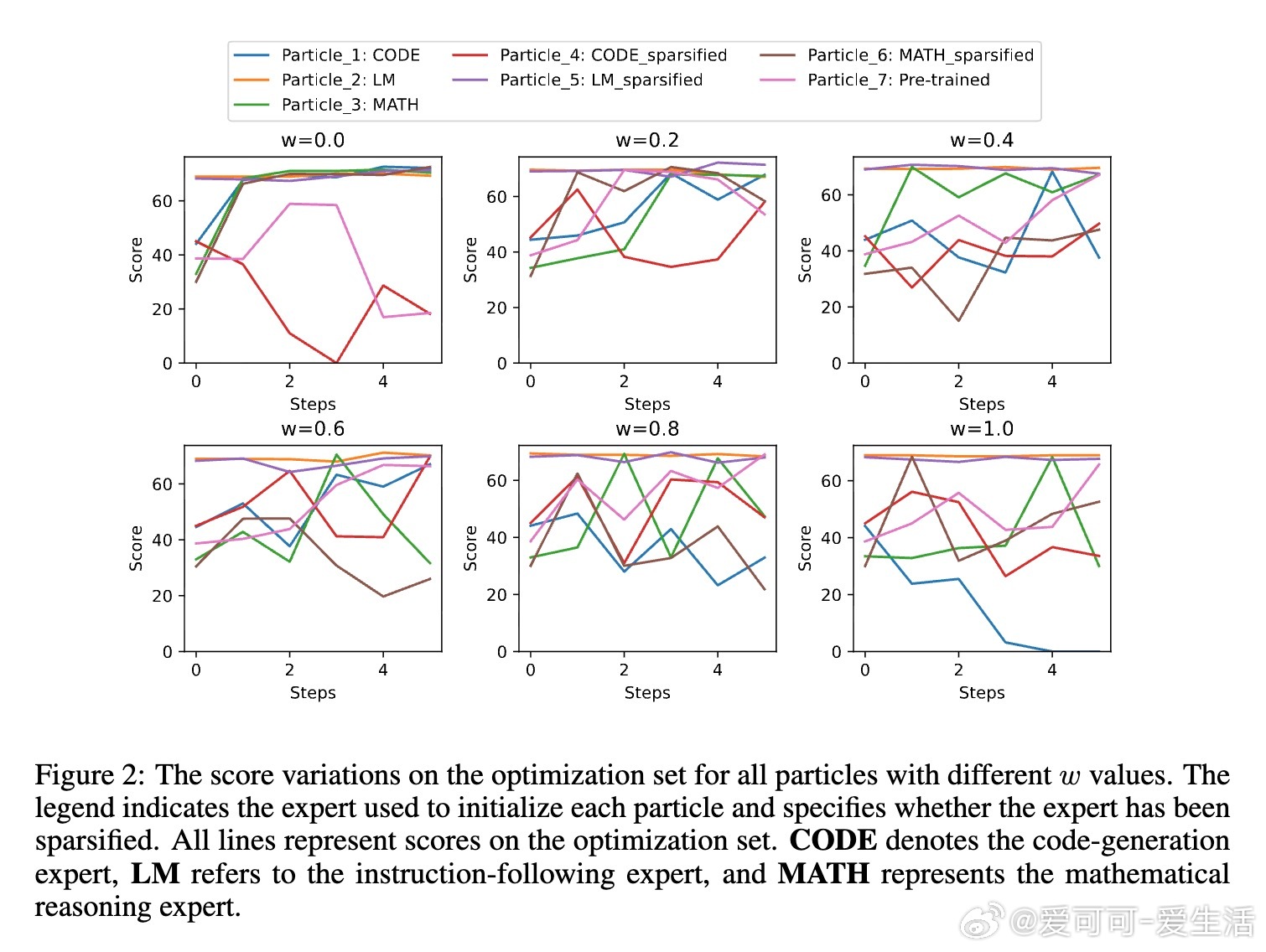

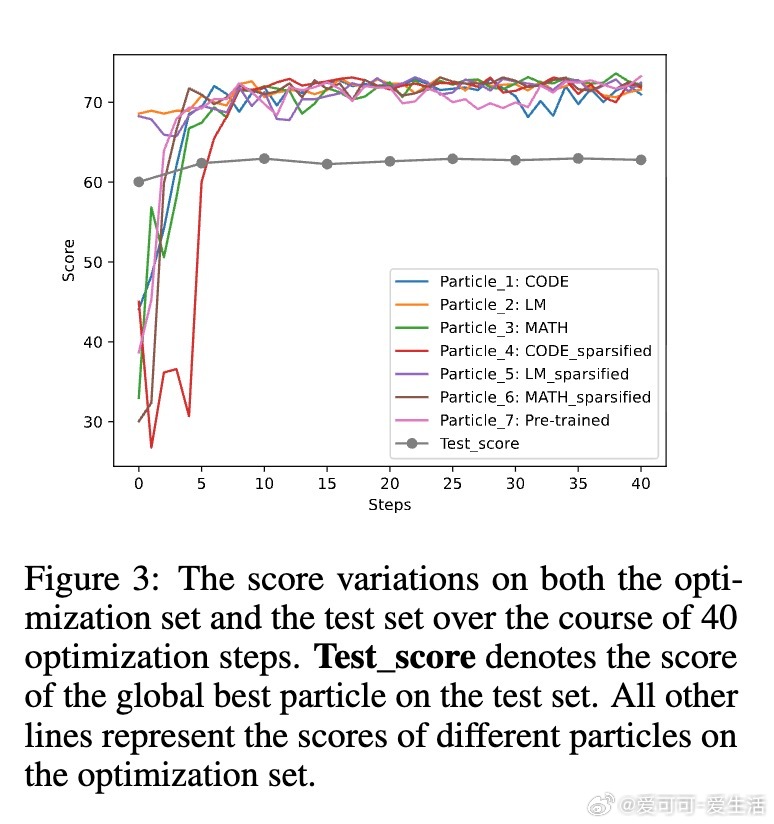

• 迭代过程中通过适应度评估、多因素速度更新结合全局与个体最优,快速逼近多任务最优解,兼顾探索与利用。

• 在Flan-T5、LLaMA及Mistral多种架构及多任务场景下,显著超越Task Arithmetic、DARE、TIES、Evo等主流基线,特别在合并多达四个专家模型时优势明显。

• 参数设置简单(如动量参数w=0.2),收敛速度快(大多数粒子5-10步内收敛),且内存消耗远低于梯度基方法,适合大规模模型合并。

• 开源代码地址:github.com/ictnlp/PSO-Merging.git,实验细节及多任务评测覆盖GLUE、AlpacaEval、GSM8K、MBPP等标准数据集。

心得:

1. 利用稀疏化机制扩展粒子群,既缓解了专家模型间的参数冲突,也促使搜索空间更丰富,提升融合效果。

2. PSO的非梯度优化特性兼顾计算效率与数据指导能力,突破了传统数据驱动合并在大模型上的应用瓶颈。

3. 多任务合并不单是简单参数平均,而是高维参数空间中基于多目标适应度的智能搜索,体现了模型融合的深层次优化思路。

了解更多🔗 arxiv.org/abs/2508.19839

大模型模型融合粒子群优化多任务学习深度学习人工智能