华为CloudMatrix 384:AI算力新“核弹”,重塑行业格局?

在AI算力的激烈竞争赛道上,华为又一次扔下了一颗“重磅炸弹”。2025年4月,华为云生态大会上,CloudMatrix 384超节点震撼发布,其强大的性能与创新架构,让整个行业为之一振,不少人称之为“核弹级产品”,它真有如此大的能量吗?

性能突破:算力、互联与效率的全面飞跃

CloudMatrix 384由384张昇腾算力卡构建而成,单集群算力强势突破300PFlops ,相较于英伟达NVL72的180PFlops ,提升幅度高达67%,在算力规模上实现了对竞争对手的超越。大规模算力卡的集成带来了海量的数据处理能力,对于那些需要处理超大规模数据的AI应用,如科研领域的基因测序数据分析、气象预测中的全球气象数据模拟,以及金融行业对海量交易数据的风险评估等场景,CloudMatrix 384能够更快速、精准地完成计算任务,为研究和决策提供有力支持。

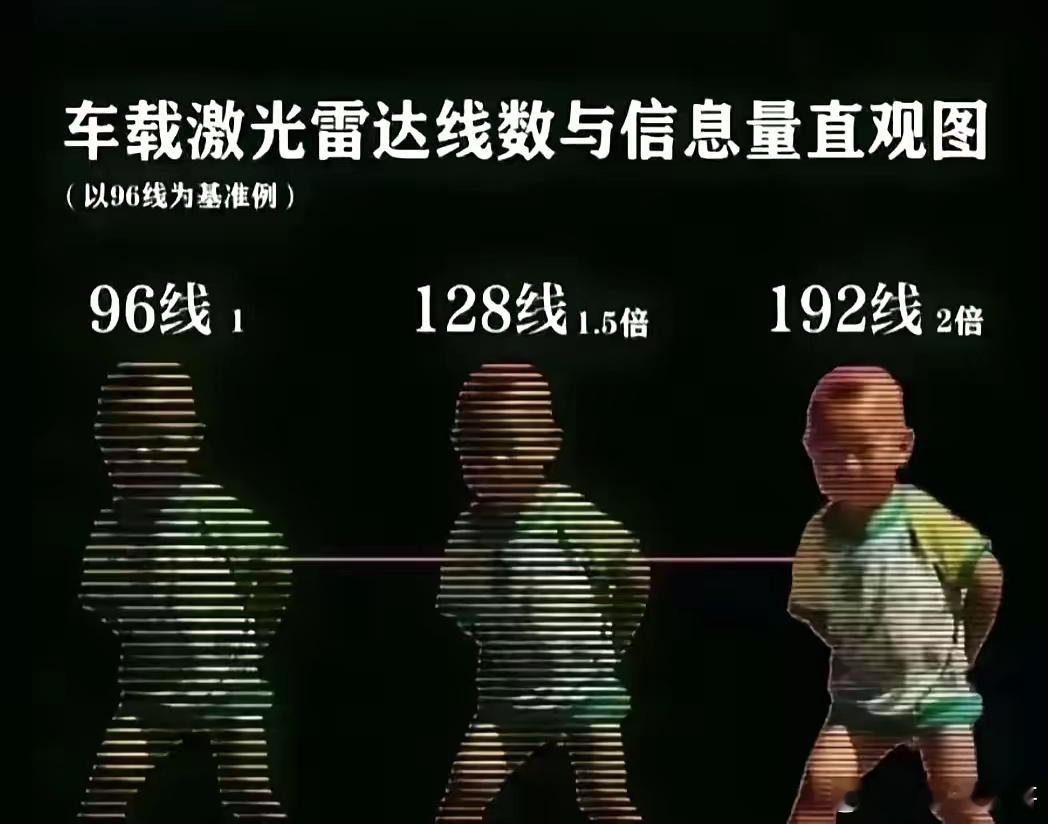

在互联带宽方面,CloudMatrix 384配备6812个400G光模块,实现了2.8Tbps的卡间互联带宽,近乎无损的数据流动让384卡之间协同工作效率大幅提升,训练效率达到单卡性能的90%,而传统架构这一效率通常仅在60%-70%。这意味着在深度学习模型训练过程中,数据能够在各算力卡之间快速传输,减少等待时间,大大缩短模型训练周期。以图像识别模型训练为例,原本需要数周的训练时间,在CloudMatrix 384的支持下,可能只需几天就能完成,加速科研和产品开发进程。

架构创新:开辟算力发展新路径

与英伟达追求单卡性能顶峰不同,华为CloudMatrix 384另辟蹊径,着眼于超大规模互联架构。这种架构转变从服务器级到矩阵级的资源供给模式,实现“一切可池化、一切皆对等、一切可组合” 。全对等互联总线和共享以太网技术的运用,将资源互联带宽提升10倍以上,打破了传统AI服务器节点间传输速度慢的瓶颈,使得大规模数据处理不再受限于传输延迟,为AI应用的拓展提供了更广阔的空间。

生态与产业影响:推动国产AI生态崛起

华为云通过昇腾AI云服务,已全面适配包含DeepSeek在内的160多个第三方大模型,为大模型训推提供可靠保障,支撑行业应用快速落地。这种“基础设施+模型”的协同模式,不仅验证了软硬一体化的可行性,更预示着中国AI产业正从“单点突破”转向“系统性领先”。对于国产AI芯片和软件企业来说,CloudMatrix 384提供了一个强大的算力平台,吸引更多企业加入到昇腾生态中来,共同推动技术创新和产业发展,构建起更完整、自主可控的国产AI产业链。

面临挑战:功耗与应用优化仍需努力

当然,CloudMatrix 384并非完美无缺。昇腾卡450W的功耗使得384卡整体功耗达172.8kW,是英伟达NVL72的2.4倍,这不仅带来了高额的能耗成本,也对散热系统提出了极高要求,液冷技术的广泛应用虽然在一定程度上缓解了散热压力,但也增加了系统的复杂性和建设成本。在应用层面,虽然目前已经在多个行业有应用案例,但对于一些特殊场景和复杂业务,还需要进一步优化和适配,以充分发挥其强大算力的优势。

综合来看,华为CloudMatrix 384超节点凭借其在性能、架构和生态等多方面的突出表现,无疑是一款具有划时代意义的产品,对AI算力格局产生了深远影响,称其为“核弹级产品”并不为过 。随着技术的不断成熟和应用的深入拓展,它有望在未来AI发展浪潮中发挥更大的作用,助力千行万业实现智能化变革。

![我觉得华为的广告投得很好特别到位[笑着哭][捂脸哭][大笑]🙏](http://image.uczzd.cn/16307691474016231157.jpg?id=0)