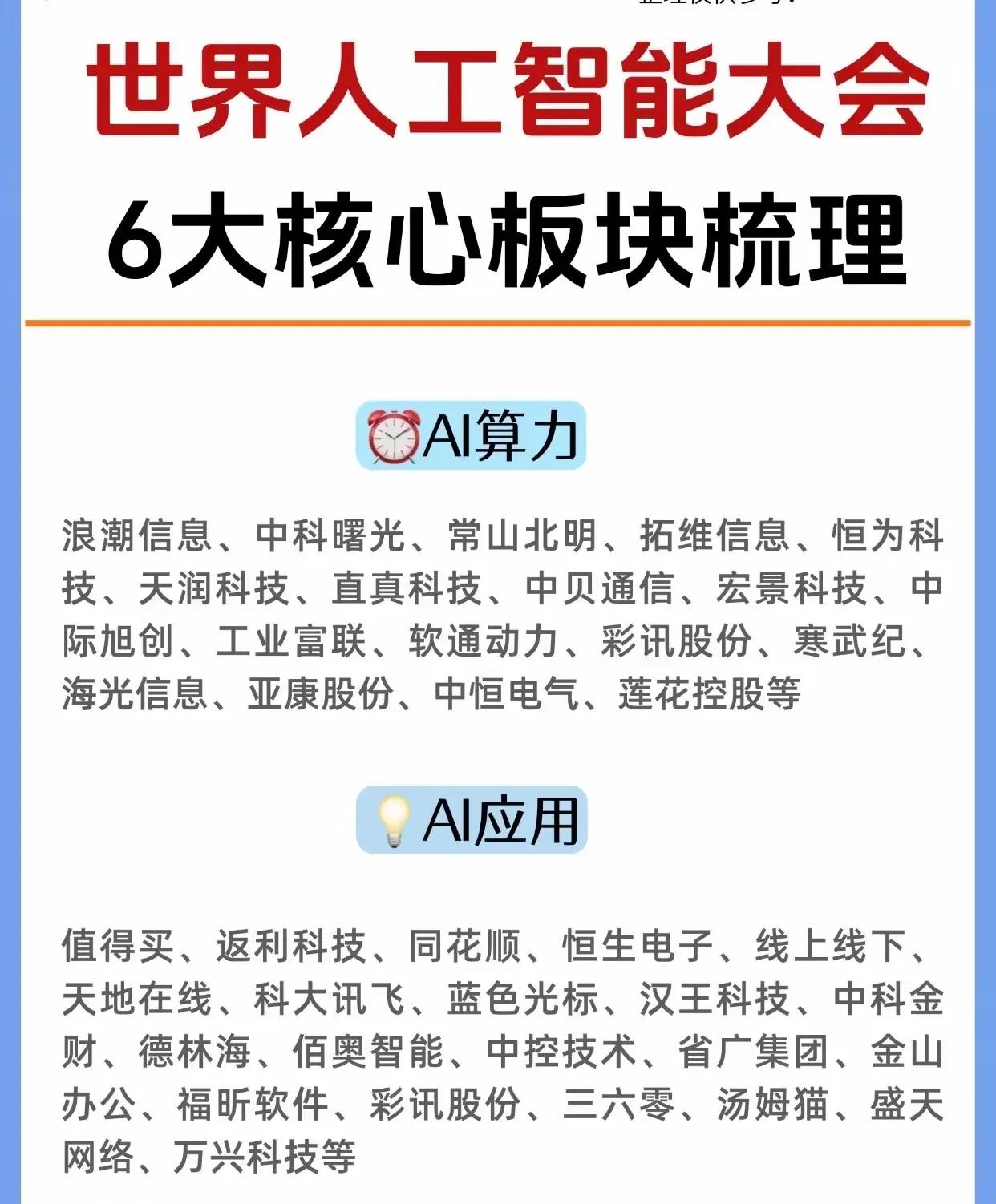

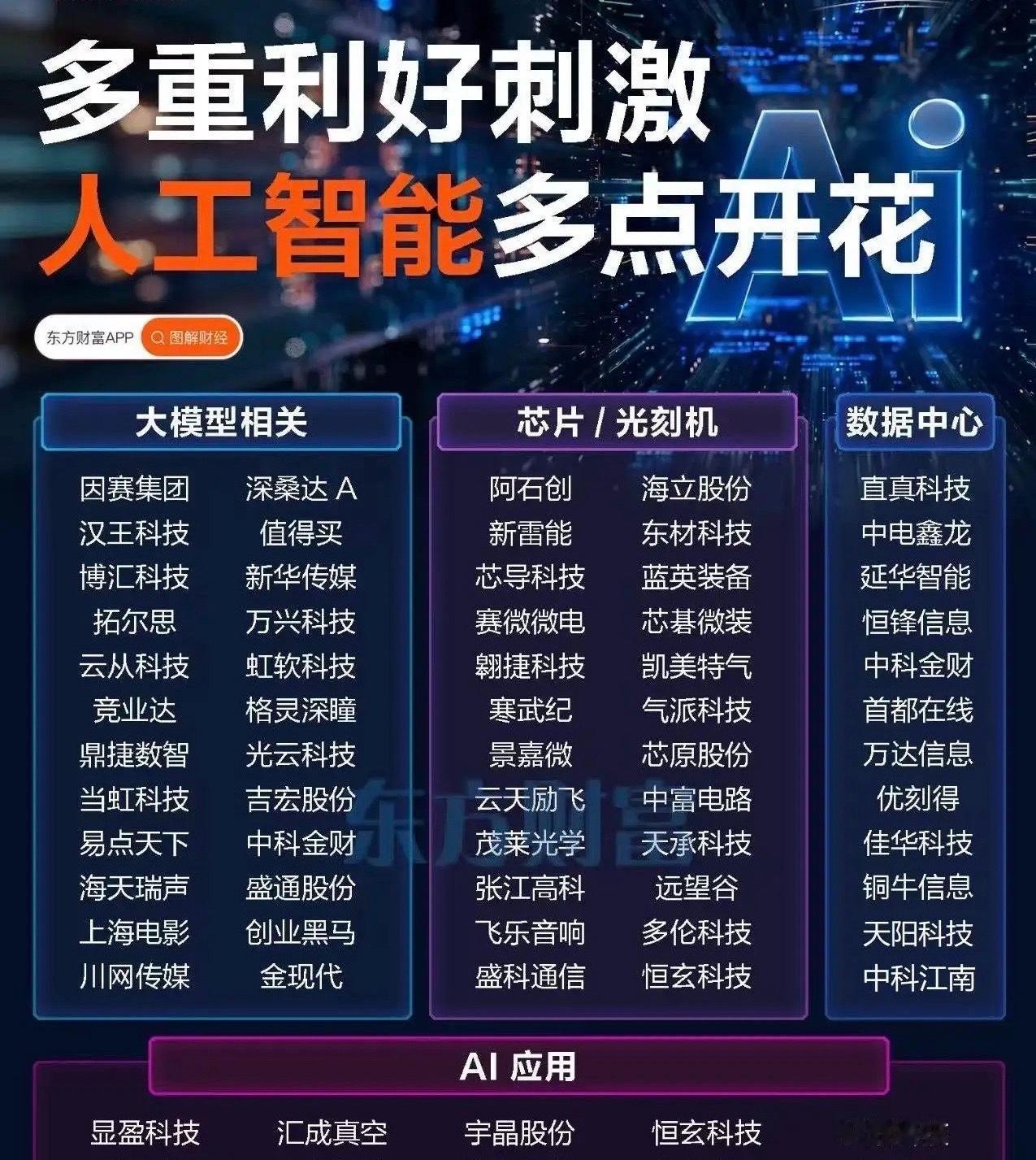

2025年7月26日,上海世博中心的世界人工智能大会展厅里,人群围住一个由12个计算柜和4个总线柜组成的灰色金属方阵。

这就是华为首次线下展出的昇腾384超节点真机,被大会评为“镇馆之宝”。

当工程师启动设备时,指示灯如星河般闪烁——384颗昇腾NPU芯片正在以每秒300千万亿次的计算速度轰鸣。

AI技术狂奔的背后是算力饥渴。

训练千亿参数的大模型时,传统计算架构暴露出致命短板:当数千张显卡集群作战,数据在服务器间来回搬运消耗了30%以上的时间;任何一张卡故障就会导致整个训练暂停。这些瓶颈让算力利用率长期卡在20%以下。

就像用一百辆卡车运货,却因道路狭窄只能排队通过。

华为的破局之道是砸碎“主从架构”的枷锁。

昇腾384超节点首创全对等架构——用自研的MatrixLink高速网络替代传统以太网,把总线从单台服务器内部扩展到整个机柜群。

384颗昇腾NPU与192颗鲲鹏CPU如同被焊在同一块电路板上,数据直达邻居芯片的时延从2微秒骤降到200纳秒。

这相当于把分散的卡车编组成磁悬浮列车,每节车厢都能自由交换货物。

数字揭示出革命性跃升:

算力总量300 Pflops,是英伟达旗舰GB200 NVL72系统的1.7倍;

内存带宽1229TB/s,超出英伟达113%;

单卡推理速度飙升至2300 Tokens/秒;

更关键的是系统效率。

在通信需求极高的多模态模型训练中,昇腾集群性能较传统方案提升3倍,算力有效利用率从20%跃升至50%。

这相当于同样的电力消耗,产出翻倍的智力成果。

硬件突破只是地基。华为同步构筑软硬件生态:

CANN工具链深度优化Transformer架构,让开发者无需重写代码;

适配国内外80余个大模型,从讯飞星火到LLaMA3皆可流畅运行;

联合2700家伙伴孵化6000+行业方案,覆盖金融风控到油田勘探;

当英伟达用户被CUDA生态绑定,昇腾用开源策略撕开裂痕——任何企业都能在开源社区获得全栈技术支持。

单颗昇腾910C芯片性能仅为英伟达Blackwell GPU的三分之一。

华为选择用系统工程弥补工艺差距:就像拼乐高,用精妙拼接让普通积木搭建出摩天大楼。

通过液冷散热与微结构导热材料攻克384卡密集部署的散热难题;针对MoE大模型设计“一卡一专家”并行模式,将资源利用率再推高50%。

黄浦江畔的展台灯光下,昇腾超节点的金属外壳映出围观者的面孔。

有硅谷工程师反复查验性能数据,有中东客户询问交货周期。

这台“算力核弹”的震撼力不仅来自参数碾压——它证明了一件事:当别人用锁链封锁道路,真正的攀登者会直接凿穿山体。

芯片工艺的差距依然存在,但系统创新的力量已推开新世界的大门。

中国AI产业第一次拥有了不从别人手中讨要钥匙的底气。