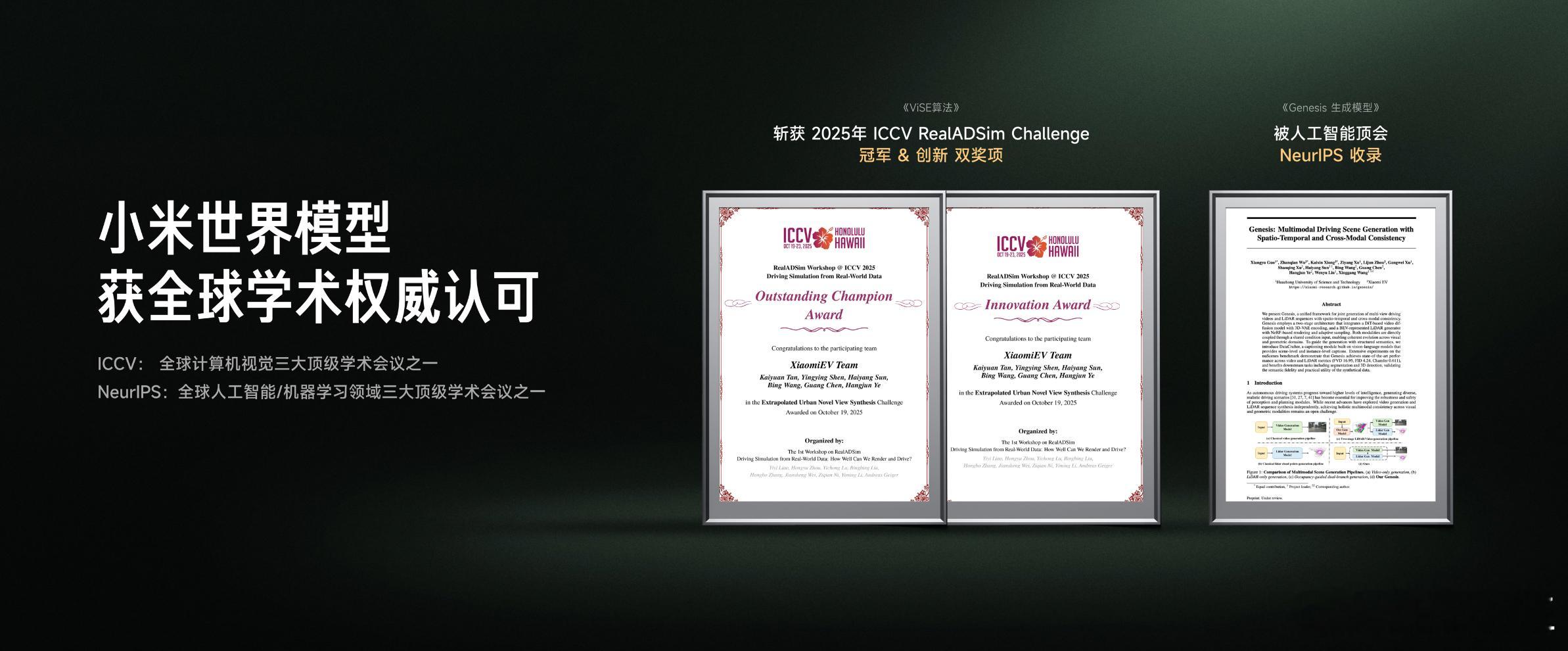

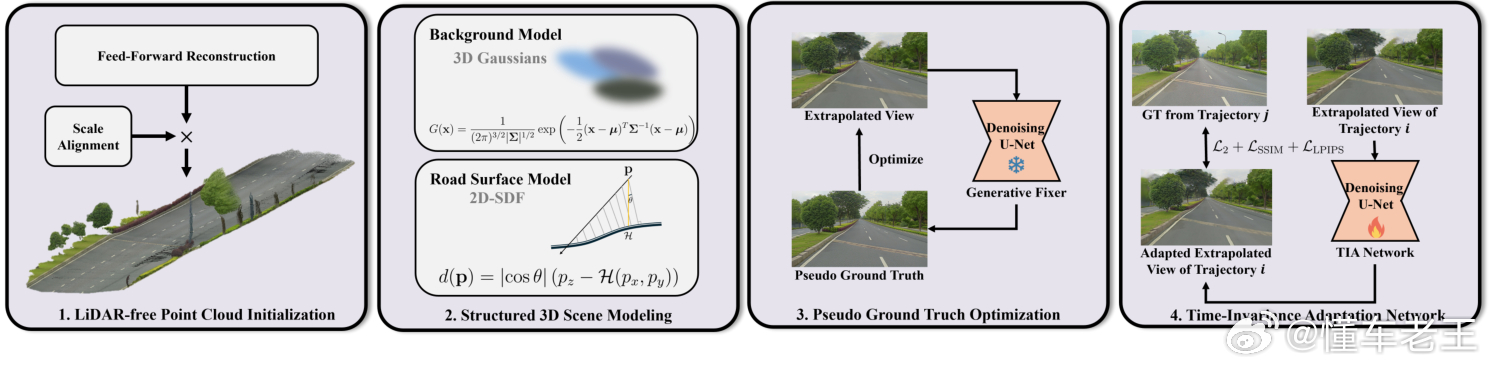

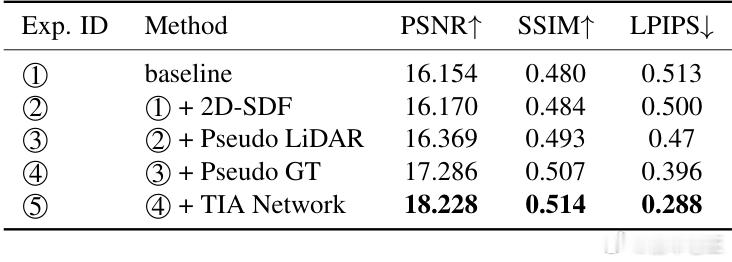

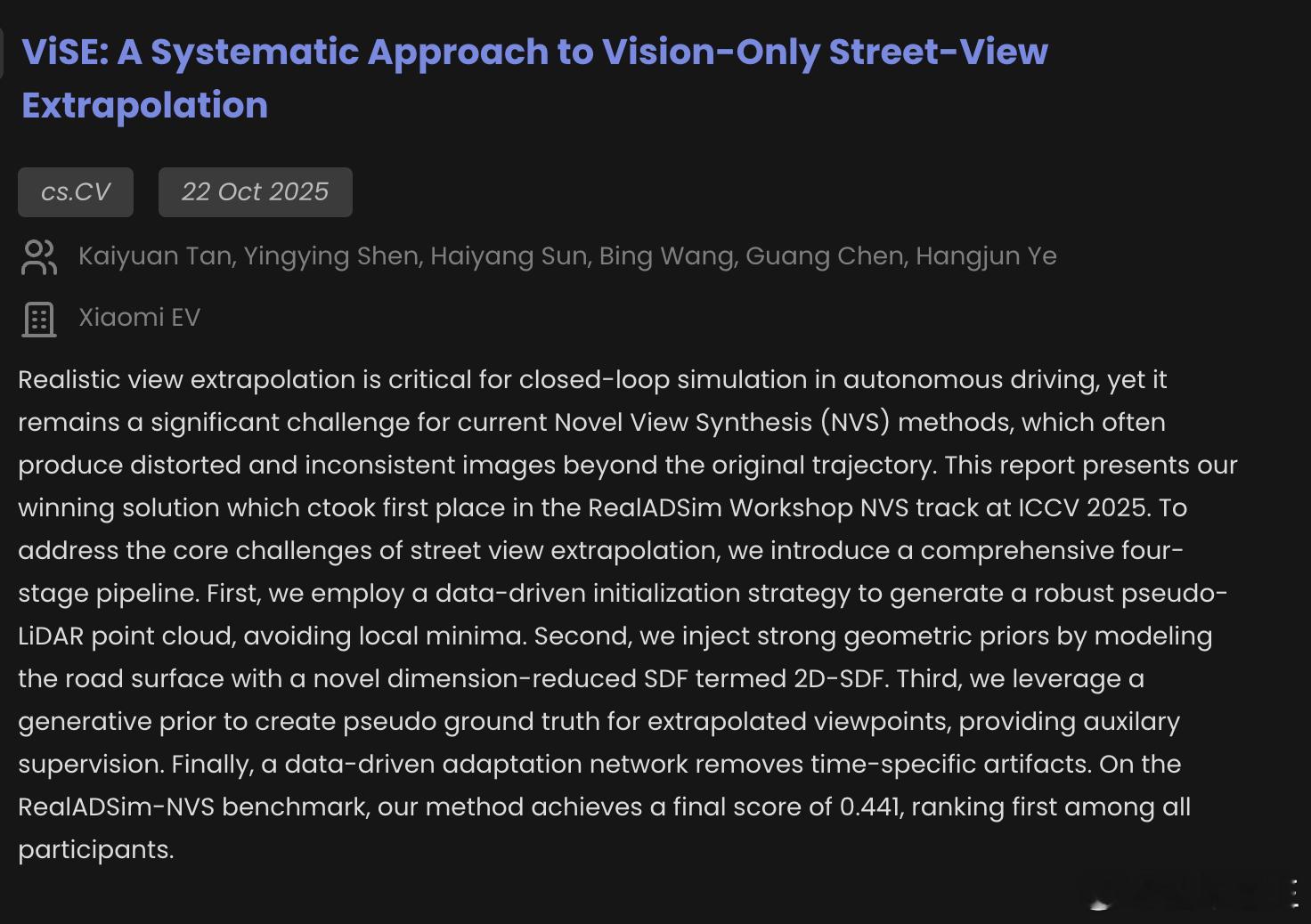

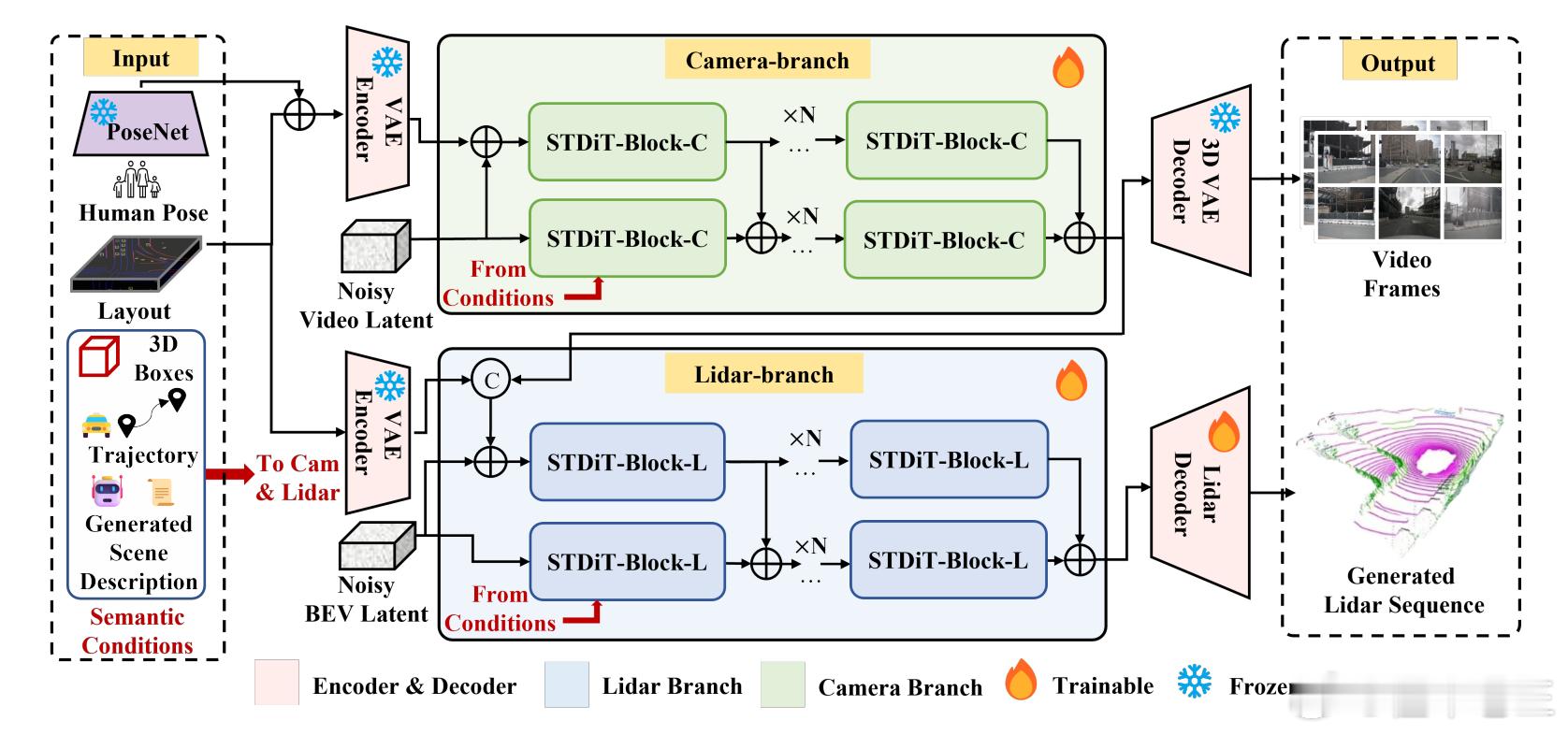

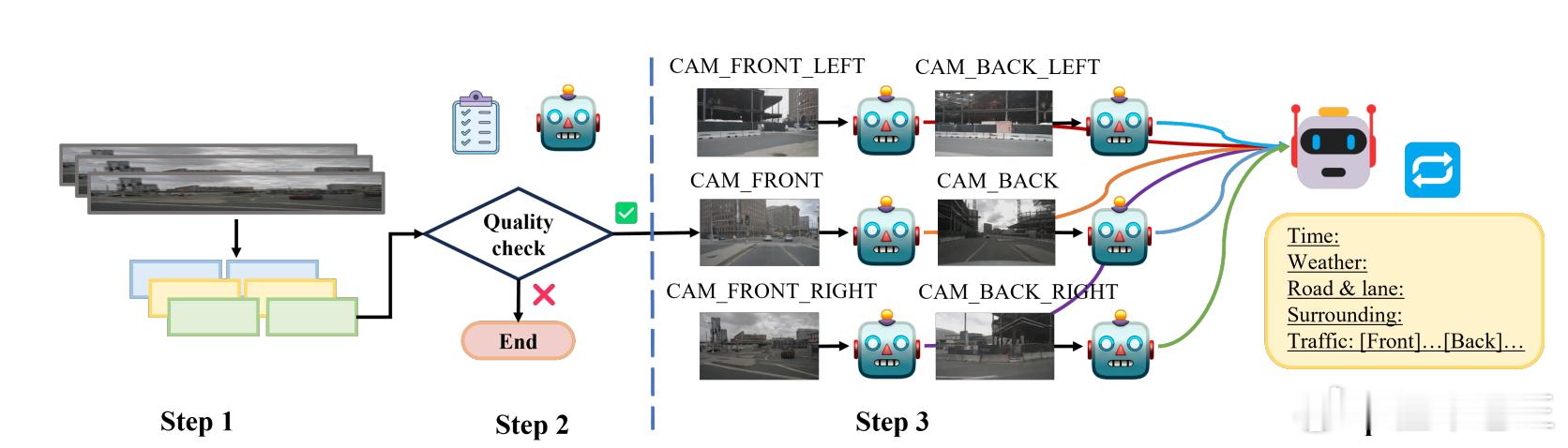

24年3月28日小米SU7发布,到25年11月20日,602天50万辆下线,手机、 智能家电、 新能源车,三个万亿级别市场的增量规模和速度确实令很多厂家侧目。 本次2025广州车展中,小米有个世界模型的相关信息还挺有意思的,就是ViSE 算法在 计算机顶刊ICCV 2025 - 自动驾驶方向仿真合成数据专业挑战赛中荣获冠军,这个大体来说啥意思呢?老王去阅读了一下这次高度相关的两篇论文《ViSE: A Systematic Approach to Vision-Only Street-View Extrapolation一种基于视觉的街景外推系统方法》和《Genesis: Multimodal Driving Scene Generation withSpatio-Temporal and Cross-Modal Consistency》 这2篇文章作者也高度重合,我总结了第一篇文章的几个关于外推的点,也学习了一下,还挺有意思的。 第一,自动驾驶在做仿真测试时(注意⚠️行业中一般直接称自动驾驶,转到舆论时需提醒法规目前无自动驾驶仅辅助驾驶,用户注意甄别),需让车辆“看到”它本来没有看到过的画面——比如从更高的视角、稍微偏一点的角度、或者车子假设往旁边挪了一米之后的街景。但现有问题就是说,一旦偏离原来的路线,就容易画面变形、透视也做的不好,镜头边缘也是糊的,那么小米这次比赛的方案就是想办法补全和外推未来的街景,他们大概有4步,第一步就是生成一个靠谱的伪激光点云,传统情况去让模型推测一个它没见过的景深结构,很容易猜错。所以小米的做法说白了就是先用大规模数据去让机器学到的一些“经验规则”,生成一个比较靠谱的3D点云骨架。就像我们画画一样,描骨架。然后进入第二部就是给模型描述一个地面,而且是连续平整的地面,这里面小米提到了一个专业名词叫做2D-SDF二维有符号距离场的概念,这个概念之前在高清矢量边界建模方面以及机器人路径规划方面常见,用这个降维的方式去减少错判和黏糊。 前面不是说要去延展到没拍到的未来视角么;那么第三步是生成模型,提前给个方向,类似目前行业里用到的Diffusion、GAN一类的(或者换种说法,2D-SDF 本身不是生成模型的动作,但它经常作为Diffusion / GAN 生成的中间过程)。最后就是第四部,用专门的一个自适应网络去清除鬼影和闪烁,尽量保证整个视频的连续,那么他们的方法在RealADSim-NVS 的评分里拿了 0.441,排名第一。【图789 为《Genesis: Multimodal Driving Scene Generation withSpatio-Temporal and Cross-Modal Consistency》篇幅有限,后续补充】另外,小米近期受舆论冲击主要是在宣传用语和用户对接节奏上面,技术宣发和边界之前的模糊处理今后建议修正为更精准、更严肃的技术解析,产品信息期待进一步透明化、白盒化。 老王认为,造车本身就是高风险、重资产行业,新玩家易被放大审视。舆论造神后的“毁神式做空冲击”也是考验车企公关耐性与资本抗荷能力的试金石,扛住之后,后续很多问题都会形成方法论和SOP。近期从产业角度看,无论是自研底盘/电控的升级动作、YU7的24 小时耐力测试、CEC 冠名,ViSE +仿真体系、还是这次的50万辆大规模下线,都说明小米汽车正试图持续加注工程能力。